これまでの記事では最新のサイバープロパガンダ手法である「Fake News(フェイクニュース)」とは何か、また「フェイクニュース」が攻撃者にとって非常に効果的かつ比較的安価な世論操作手法となっていることについて、連載形式で解説してまいりました。いまや「フェイクニュース」は各国の政府機関や企業、また個人にとっても無関係ではいられない脅威と化してきました。今回の記事では、拡大中の脅威としての「フェイクニュース」への対策方法について考察します。

■政府やソーシャルメディアにおける「フェイクニュース」対策の現状

既に「フェイクニュース」の影響を受けている欧州、中南米、アジア太平洋地域の多くの国々では、「フェイクニュース」への様々な対策が進められています。例として、ロシア外務省は自国に対する虚偽情報を含む出版物のリストを公開するための Web サイトを立ち上げました。同様に、欧州連合(EU)の機関である欧州対外行動庁(EEAS)の Web サイトでも、虚偽の情報を含む Web 上のコンテンツに対するレビューを毎週公開しています。また、英国の独立機関でも同様のイニシアチブが実施されており、選挙関連のニュース記事を監視し、虚偽情報を暴いています。また、ドイツでは 2017 年に行う総選挙に先立ち「フェイクニュース」対策とも呼べる法案が導入されました。この法案では、虚偽情報を含むコンテンツを速やかに削除するなどのルールに従わないソーシャルメディアサイトに対し、5 千万ユーロ(およそ 65 億円)もの罰金を科す内容が含まれています。

また、「フェイクニュース」の拡散や意見誘導のプラットホームとして攻撃者に悪用されているソーシャルメディア側でも、様々な対策が進められています。特に、Facebook、Google、Weibo、WeChat などのソーシャルメディアでは、自身がホストする各種コンテンツに対する監視を強めています。例えば、Google は、ニュース検索ページに掲載されているニュース記事に対し、差別的発言やフェイクニュースなど事実確認のタグ付けができる機能を導入しました。また Facebook では、ニュースフィード上で「フェイクニュース」をフィルタリングする仕組みの改善を行っています。また、フランスにおいて不審アカウント 3 万件を停止する、「フェイクニュース」の認知向上のため英国の主要な新聞に広告を出す、などのアクションも行っています。これらの Facebook の取り組みは「フェイクニュース」の収益性を低下させ、その普及を抑制する新しい技術を追加し、ユーザーにより良いツールを提供することを目指しているものと言えます。

Twitter でも、一般的なルールと利用者向けガイドラインの策定と共に、ツイートの自動化に関連するサードパーティアプリ開発者用のポリシー提供を行っています。ポリシーには、重複、または冗長な情報を投稿する複数アカウントの作成禁止などが含まれており、「フェイクニュース」のために使用されるような自動化システムを発見し、追跡するのに役立っています。Twitter はこのようなポリシーを回避しようとする悪質なボットアカウントの停止にも積極的です。

■一般のインターネット利用者が行うべき「フェイクニュース」対策

現在のところ、「フェイクニュース」の攻撃手法に対し、一般のインターネット利用者が活用できる技術的対策はほとんどありません。「フェイクニュース」で使用される主要なプラットホームは正規のニュースサイトやソーシャルメディアサイトであるため、「フェイクニュース」のコンテンツを単純にブロックするような対策は困難です。前述のような各種ソーシャルメディアにおける「フェイクニュース」対策の動きに期待することになります。利用者側では「フェイクニュース」の存在と目的を認知し、その騙しの手口を理解して扇動に乗らないよう、自身で注意する必要があります。

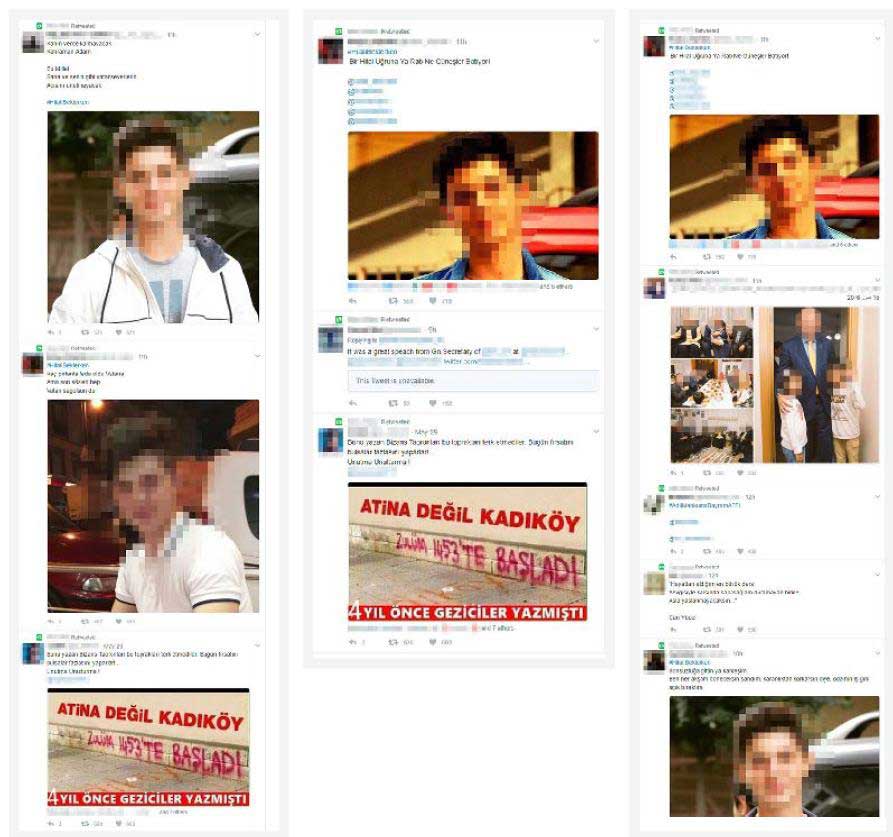

特にソーシャルメディア上での不審な活動に気づける例を挙げます。ボットによる偽情報拡散では、全く同じ文面が複数の投稿で使用されることが多く見られます。以下は 2017 年のフランス大統領選挙前に拡散されたツイートの例です。

複数のアカウントから同じ文面のツイートがポストされており、典型的なボットアカウントによる偽情報の拡散であると推測されます。また、以下のように複数のアカウントのタイムラインに前後して同じツイートがポストされることもあります。

フランス大統領選の際の「フェイクニュース」キャンペーンでは、トレンドマイクロが確認しただけでも 5,400 以上の不審なアカウントがこのような偽情報拡散を行っていました。そして、このような偽情報の拡散の中心には、実在の人間による「先導者」アカウントが存在します。トレンドマイクロの調査では、フランス大統領選の際に使用された「先導者」アカウントの一部は、2017 年 5 月に発生したマンチェスターにおける爆破事件における偽情報の拡散の際にも使用されていたことがわかっています。これは、「フェイクニュース」の背後にいる攻撃者の存在とその手口が垣間見えた例と言えます。

上記のようなソーシャルメディア上での不審点に加え、利用者側で気づくことができる「フェイクニュース」の特徴には以下があります:

- 興味を引くための誇張された記事見出し

- 正規ニュースメディアを詐称する不審な Web サイトのドメイン

- 記事内のスペルミスや不自然なレイアウト

- 加工、修正された写真や画像

- 公開日情報、著者、情報源、データなどのあるべき情報が欠如している

人は一般的に、自分の期待や信念と合致しない情報は信用せず、信念に合う情報や自分に都合の良い情報などを信じやすい傾向があります。「フェイクニュース」攻撃者は、まさにこのような一般大衆の傾向を利用して意見の誘導を行います。「フェイクニュース」の扇動に乗せられないためには、上記の「フェイクニュース」の特徴を意識した上で、以下の観点に注意してニュースを判断すべきです。

- 記事の見出しだけで判断せず、内容をよく読む

- 1 つの記事だけで判断せず、別のメディアでの報道内容をチェックする

- 記事で使用されている外部リンクや情報源を精査し、他の誤情報で使用されていないか確認する

- 記事の著者や掲載場所、掲載時期などを確認する

- 記事で使用されている画像を相互参照し、修正されていないか確認する

- ソーシャルメディア上で記事を広めようとするコメントなどがある場合、その整合性を確認する(投稿者のプロフィールが実在か、同じコメントが何度も投稿されていないか、複数の類似する投稿のタイムスタンプの間隔があまりにも短くないか、など)

インターネット、中でも特に Facebook、Twitter、その他のソーシャルメディアが、実世界に非常に強い影響を与えています。ソーシャルメディアの利用者は、その時の気分や感情などの主観的要因で動く傾向にあります。「フェイクニュース」の攻撃者はこの傾向を利用し、受け取り手の欲求に沿った情報をもっともらしく与え、意見の誘導を行います。受け取る側が信じたい情報は、虚偽であってもすばやく世界に拡散されます。米国とフランス、2 つの国の大統領選挙の際に発生した事象からは、「フェイクニュース」は非常に効果的な世論操作手法であり、1 つの国の進路すら変える可能性があることがわかります。もはや「フェイクニュース」のようなサイバープロパガンダを「インターネットの中だけのこと」として無視することはできません。既に各国政府や主要ソーシャルメディアは「フェイクニュース」の脅威を認識し、様々な対策を進めています。同時に、すべてのインターネット利用者は「フェイクニュース」というサイバープロパガンダ手法の存在とその手口を知り、扇動に乗らないように注意する必要があります。

※本記事の内容は当社発行のレポート「The Fake News Machine: How Propagandists Abuse the Internet and Manipulate the Public」(英語)に基づくものです。「フェイクニュース」に関してより深く知るためにはレポートをご一読ください。

参考記事:

「Exploring the Online Economy that Fuels Fake News」

By Lion Gu, Vladimir Kropotov and Fyodor Yarochkin (Senior Threat Researchers)

■「Fake News(フェイクニュース)」連載記事リンク:

- 「フェイクニュース」:インターネットを利用した世論操作

/archives/15770 - 安価に可能な世論操作、「フェイクニュース」の価格相場は?

/archives/15778 - 「フェイクニュース」を見破るためには?(本稿)

/archives/15789

※記事構成:岡本 勝之(セキュリティエバンジェリスト)